Big data, bigger discrimination?

“Sì, è vero, Google sa che voglio cambiare macchina, che ho comprato un volo per Catania e che mi piacciono i California roll. E allora? Mica è proibito”. Nell’era dei big data difendere la propria privacy diventa un lavoro estenuante che spesso porta a gettare la spugna “tanto, non ho niente da nascondere”. Non tutti i nostri comportamenti però vengono considerati “insignificanti” allo stesso modo: per un musulmano della minoranza uigura in Cina anche un pieno di benzina può essere interpretato come comportamento sospetto. Roberta Medda-Windischer, giurista esperta in diritti delle minoranze di Eurac Research, racconta come l’uso dei big data possa sfuggire di mano e ritorcersi contro i principi democratici.

Secondo Amnesty International, in fatto di protezione della privacy, la tendenza più diffusa tra le persone è quella riassunta dal principio “Nothing to hide, nothing to fear”, ma davvero, se non abbiamo niente da nascondere, possiamo stare tranquilli?

Medda-Windischer: Purtroppo non siamo noi a decidere quali comportamenti siano da considerare “innocui” e quali no. Lo decide chi detiene quei dati e, in paesi poco attenti alla libertà personale, comportamenti che altrove verrebbero considerati normali possono destare sospetti, soprattutto se a compierli sono persone appartenenti a una minoranza. Completamente tranquilli comunque non possiamo essere nemmeno noi, che viviamo in società democratiche. È recente la notizia secondo cui la società inglese Cambridge Analytica avrebbe sfruttato i dati raccolti tramite facebook per spingere l’elezione di Trump e la Brexit: post mirati sulle bacheche di oltre 78 milioni di utenti avrebbero orientato le scelte di voto negli Stati Uniti e nel Regno Unito.

Stregati dalla comodità di aver accesso a una miriade di informazioni, non ci siamo preoccupati di mettere delle regole e di definire dei limiti, pensando che tanto non abbiamo niente da nascondere.

Parlava di minoranze. Ci può fare un esempio?

Medda-Windischer: Lo scorso febbraio Human Rights Watch ha denunciato il modo in cui le autorità cinesi controllano la minoranza uigura di religione musulmana che vive nella regione dello Xinjiang. Con l’obiettivo di schedare le abitudini quotidiane dei cittadini per identificare comportamenti sospetti e combattere il terrorismo, il governo locale raccoglie informazioni sulla minoranza musulmana attraverso telecamere a circuito chiuso, intercettazione dei collegamenti alle reti wifi, posti di blocco. Azioni molto banali ‒ come non aver pagato la bolletta del telefono, avere in casa molti libri, aver acquistato più fertilizzante rispetto al solito ‒ fanno scattare le perquisizioni a domicilio e, in certi casi, la detenzione in centri di rieducazione. Human Rights Watch stima che da aprile 2016 nello Xinjiang siano state recluse decine di migliaia di persone appartenenti a minoranze.

Di fronte a questi numeri è difficile pensare che fossero tutti potenziali terroristi. Quanto è concreto il pericolo che i big data possano rafforzare stereotipi di stampo etnico?

Medda-Windischer: Le attività di sorveglianza non si indirizzano allo stesso modo verso tutti, lo sanno bene le cosiddette minoranze “visibili” che vengono fermate ai posti di controllo non per un comportamento che oggettivamente solleva sospetti, ma sulla base dei loro tratti somatici. I big data possono accentuare questa disparità di trattamento, come dimostra il controverso caso dei sistemi di polizia predittiva con cui vengono raccolti dati su crimini compiuti in passato per sventare quelli futuri. Effettivamente questi software hanno permesso di ridurre sensibilmente il numero di reati in diverse città sia in Italia che all’estero, ma c’è il rischio che diventino strumenti di profilazione razziale. Se analizzando il video di una rapina in farmacia i poliziotti annotano che il rapinatore ha la pelle scura, è difficile evitare che tutti gli uomini africani che entrano in farmacia siano considerati potenziali delinquenti. È impossibile impedire che i dati raccolti possano prestarsi a una deriva di tipo razzista. C’è poi un altro meccanismo che entra in gioco, ed è quello della profezia che si auto-adempie. Se la polizia ha disposto dei controlli in una certa zona della città – magari abitata da minoranze etniche – è facile che lì intervenga più spesso. Per l’algoritmo su cui si basano questi sistemi di controllo, quello diventa il quartiere in cui vengono commessi più crimini e i controlli di polizia verranno ulteriormente intensificati. Sempre più quindi quella zona verrà considerata a rischio, mentre quartieri in cui la polizia è meno presente potrebbero restare ignoti all’algoritmo. Si genera una sorta di corto circuito delle informazioni.

Il quadro è intricato, dai dati che volontariamente consegniamo a facebook a quelli che vengono raccolti senza il nostro consenso. Evitare manipolazioni e discriminazioni sembra impossibile.

Medda-Windischer: Mi viene in mente l’apprendista stregone, il protagonista del film d’animazione della Disney basato su una ballata di Goethe. Lasciato solo, l’assistente del mago pensa di farsi aiutare da scopa e secchio per riassettare la stanza. Pronuncia le parole magiche per animarli e pensa di aver risolto il suo problema, ma poi la situazione gli sfugge di mano, scope e secchi stanno allagando la stanza e l’apprendista non conosce la formula per ripristinare l’ordine. Con i big data mi pare sia successa la stessa cosa: stregati dalla comodità di aver accesso a una miriade di informazioni, non ci siamo preoccupati di mettere delle regole e di definire dei limiti, pensando che tanto non abbiamo niente da nascondere. Peccato che la formula magica per fermare la scopa non la conosciamo, o forse la conosciamo ma non siamo interessati a pronunciarla perché questo implicherebbe una forte volontà politica e il nostro impegno quotidiano nell’uso dei sistemi informatici.

Related Articles

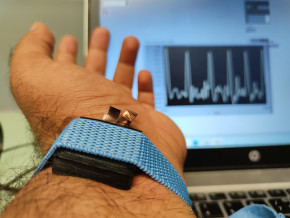

Tecno-prodotti. Creati nuovi sensori triboelettrici nel laboratorio di sensoristica al NOI Techpark

I wearable sono dispositivi ormai imprescindibili nel settore sanitario e sportivo: un mercato in crescita a livello globale che ha bisogno di fonti di energia alternative e sensori affidabili, economici e sostenibili. Il laboratorio Sensing Technologies Lab della Libera Università di Bolzano (unibz) al Parco Tecnologico NOI Techpark ha realizzato un prototipo di dispositivo indossabile autoalimentato che soddisfa tutti questi requisiti. Un progetto nato grazie alla collaborazione con il Center for Sensing Solutions di Eurac Research e l’Advanced Technology Institute dell’Università del Surrey.

unibz forscht an technologischen Lösungen zur Erhaltung des Permafrostes in den Dolomiten

Wie kann brüchig gewordener Boden in den Dolomiten gekühlt und damit gesichert werden? Am Samstag, den 9. September fand in Cortina d'Ampezzo an der Bergstation der Sesselbahn Pian Ra Valles Bus Tofana die Präsentation des Projekts „Rescue Permafrost " statt. Ein Projekt, das in Zusammenarbeit mit Fachleuten für nachhaltiges Design, darunter einem Forschungsteam für Umweltphysik der unibz, entwickelt wurde. Das gemeinsame Ziel: das gefährliche Auftauen des Permafrosts zu verhindern, ein Phänomen, das aufgrund des globalen Klimawandels immer öfter auftritt. Die Freie Universität Bozen hat nun im Rahmen des Forschungsprojekts eine erste dynamische Analyse der Auswirkungen einer technologischen Lösung zur Kühlung der Bodentemperatur durchgeführt.

Gesunde Böden dank Partizipation der Bevölkerung: unibz koordiniert Citizen-Science-Projekt ECHO

Die Citizen-Science-Initiative „ECHO - Engaging Citizens in soil science: the road to Healthier Soils" zielt darauf ab, das Wissen und das Bewusstsein der EU-Bürger:innen für die Bodengesundheit über deren aktive Einbeziehung in das Projekt zu verbessern. Mit 16 Teilnehmern aus ganz Europa - 10 führenden Universitäten und Forschungszentren, 4 KMU und 2 Stiftungen - wird ECHO 16.500 Standorte in verschiedenen klimatischen und biogeografischen Regionen bewerten, um seine ehrgeizigen Ziele zu erreichen.

Erstversorgung: Drohnen machen den Unterschied

Die Ergebnisse einer Studie von Eurac Research und der Bergrettung Südtirol liegen vor.